A questão negra na regulação das plataformas digitais: uma análise da consulta realizada pelo CGI.br

Fernanda dos Santos Rodrigues Silva é doutoranda em Direito, Tecnociências e Interdisciplinaridade pela Universidade Federal de Minas Gerais (UFMG). Mestre em Direitos na Sociedade em Rede e graduada em Direito pela Universidade Federal de Santa Maria.

Marco Antônio Sousa Alves é professor adjunto de Teoria e Filosofia do Direito da Universidade Federal de Minas Gerais (UFMG). Subcoordenador do Programa de Pós-Graduação em Direito (PPGD/UFMG). Bolsista de Produtividade em Pesquisa FAPEMIG/CNPq.

Mariana Alves Araújo Lopes é mestranda em Direito, Tecnociências e Interdisciplinaridade pela Universidade Federal de Minas Gerais (UFMG). Facilitadora e participante do Programa Youth Brasil @ CGI.br (edições 2024 e 2022).

Resumo

Em 2023, o Comitê Gestor da Internet obteve mais de 1.000 contribuições em consulta pública sobre regulação de plataformas digitais no Brasil. Considerando que um dos grupos mais vulnerabilizado e hostilizado online é justamente o de pessoas negras, especialmente mulheres negras, o presente artigo tem por finalidade analisar como surgiu a questão racial e de que modo foi endereçada no debate. Partiu-se do pressuposto de que o marco regulatório brasileiro sobre plataformas digitais precisa ser explicitamente antirracista para impedir a reprodução do racismo estrutural. O método de abordagem foi o indutivo, partindo do texto da consulta e contribuições dos consultados, e o método de procedimento, de análise de conteúdo. As principais conclusões indicam que, embora tenha ocorrido avanço na interseção entre regulação de plataforma e o debate racial, ainda há dificuldades. O consulente, ao formular as questões, foi genérico, sem enfocar diretamente o racismo. Nas contribuições, sugeriu-se uma regulação que garanta uma moderação de conteúdo mais inclusiva, auditorias algorítmicas, relatórios sobre discriminação racial e a criação de uma autoridade regulatória com composição diversificada, incluindo representação racial, dentre outros. Apesar disso, o total de menções à questão racial foi baixo em relação ao número total de contribuições.

Introdução

A necessidade e a urgência de regular plataformas digitais é algo cada vez mais consensual, sendo, inclusive, pauta do documento aprovado unanimemente por 193 países-membros na última Assembleia Geral da ONU, ocorrida em setembro de 2024, intitulada “Pacto para o futuro” (Pact for the future) (UN, 2024). Sistemáticas e graves violações de direitos fundamentais, discursos de ódio, exploração sexual infantojuvenil, racismo, desinformação, ações terroristas e ameaças à democracia são alguns dos problemas encontrados. Embora a identificação da pauta mais relevante e a escolha dos meios de enfrentamento estejam longe de ser algo pacificado, a percepção de não mais ser possível deixar as grandes plataformas digitais simplesmente desreguladas ou apenas autorreguladas tende a prevalecer contemporaneamente.

No Brasil, esse debate também está vivo e tem grande projeção. Os esforços para regulação do espaço digital intensificaram-se desde 2009, quando foi iniciada uma consulta pública para redação do projeto do que, em 2014, se tornou o Marco Civil da Internet (Lei 12.965) (Brasil, 2014). Embora esse marco faça um esforço na atribuição de responsabilidades, dentre outras, aos provedores de conteúdo, ele se mostrou insuficiente para dar conta da complexidade de relações, serviços e impactos das plataformas digitais na sociedade brasileira. Diante dessa lacuna, tem-se como principal iniciativa legislativa o Projeto de Lei (PL) 2.630, de 2020, que institui a Lei Brasileira de Liberdade, Responsabilidade e Transparência na Internet e tramita atualmente na Câmara de Deputados (Brasil, 2020).

Procurando ampliar esse debate e contribuir para a construção consensual de um marco regulatório brasileiro sobre plataformas digitais, o Grupo de Trabalho de Regulação de Plataformas do Comitê Gestor da Internet do Brasil (CGI.br) promoveu, dentre outros eventos nos últimos anos, uma consulta pública realizada entre abril e julho de 2023. Com mais de 1,3 mil contribuições recebidas, a consulta apresenta um amplo mapeamento de questões em jogo no debate brasileiro sobre a questão e oferece propostas relevantes para o endereçamento das medidas regulatórias.

O presente trabalho pretende, a partir da análise dessa consulta, refletir sobre como a questão racial negra aparece e é endereçada nesse recorte do debate brasileiro acerca da regulação das plataformas digitais. Embora o Brasil tenha experimentado mais de três séculos de regime escravocrata, sendo fortemente marcado pelo racismo (Moura, 2019; Nascimento, 2016), especialmente contra pessoas negras1, é também um país com grande dificuldade de abordar diretamente essa questão e enfrentá-la adequadamente (Gonzalez, 1988). Essa dificuldade aparece também no debate sobre a regulação das plataformas digitais, no qual se insere a consulta analisada, que nem sempre trata a discriminação racial como um dos grandes riscos envolvidos em um moderação de conteúdo inadequada. Apesar de a regulação de plataformas envolver mais do que apenas normas para moderação, esta é uma das atividades mais relevantes realizadas por intermediários, uma vez que atinge diretamente direitos fundamentais, como é o caso da liberdade de expressão. Nesse contexto, um dos grupos mais vulnerabilizado, hostilizado e prejudicado nos ambientes online é justamente o das pessoas racializadas, especialmente as mulheres negras, que sofrem diversas desvantagens e são vítimas de inúmeras formas de violência. Entendemos que o marco regulatório brasileiro sobre plataformas digitais precisa ser direta e ativamente antirracista, de modo a impedir a reprodução do racismo estrutural; logo, procuraremos, neste trabalho, verificar como essa questão foi tratada na consulta do CGI.br.

Para tanto, a metodologia abordada foi indutiva, partindo do texto da consulta e das contribuições dos consultados, com a utilização do método de análise de conteúdo. Assim, na primeira parte deste artigo (seção 2), apresentaremos algumas especificidades do problema racial no Brasil e analisaremos diferentes expressões do racismo contra pessoas negras nas plataformas digitais e por meio delas. Em seguida, empreenderemos uma análise da consulta realizada pelo CGI.br, a fim de identificarmos como essa temática aparece e é enfrentada. Após alguns esclarecimentos metodológicos (seção 3), este artigo procurará sintetizar seus resultados tanto pela perspectiva das perguntas propostas pelo consulente (seção 4), quanto pelos comentários feitos pelos consultados (seção 5).

O racismo antinegro em plataformas digitais

O racismo é um fenômeno múltiplo e complexo, fortemente contextualizado, com diversas formas de manifestação e ocultamento, passando não só por agressões explícitas e intencionais, mas também por ofensas implícitas, encobertas ou não intencionais. Para compreender a forma com que o racismo opera na e por meio de plataformas digitais, convém recuperar brevemente as duas formas básicas pelas quais ele se apresenta, quais sejam, a discriminação racial direta e a indireta. A primeira é a forma mais comumente identificada, pois se manifesta de maneira clara e inequívoca. Trata-se do tipo de discriminação proferida, por exemplo, por meio de ofensas, ou seja, mediante termos e expressões que visam diminuir, menosprezar ou colocar em desvantagem as pessoas em virtude de sua raça.

De acordo com Luiz Valério Trindade (2018), as maiores vítimas dessa forma de discriminação nas redes sociais, em especial no Facebook, são mulheres negras de 20 a 35 anos, de classe média, com Ensino Superior completo. O recorte específico desse público-alvo demonstra que nem mesmo a ascensão social é um fator capaz de impedir a discriminação: pelo contrário. As postagens mais vulneráveis a ofensas racistas são justamente aquelas em que mulheres negras demonstram exercer posição de liderança ou de destaque, por exemplo, conduzindo um programa televisivo, desfrutando de férias, viajando ao exterior ou em profissões de maior prestígio social, como medicina e direito. O estudo conduzido por Trindade (2018) mostrou também que as ofensas aumentavam quando mulheres negras se contrapunham ou discordavam de postagens de cunho negativo contra outras pessoas negras.

A misoginia, em casos como esses, foi reafirmada em pesquisa realizada pela Faculdade Baiana de Direito, JusBrasil e PNUD (2023), que analisou decisões judiciais sobre racismo e injúria racial entre os anos de 2010 e 2022. Identificou-se que a maioria dos insultos destinados a mulheres negras versavam sobre sua higiene, sexualidade ou estética. Por outro lado, as ofensas contra homens negros concentravam-se na inferiorização social. Já a discriminação racial indireta é aquela que se manifesta de forma dissimulada, mediante práticas aparentemente neutras, mas que resultam em atos discriminatórios que colocam as pessoas negras novamente em desvantagem em razão de sua raça (Brasil, 2022). Em plataformas digitais, isso ocorre especialmente por meio da moderação de conteúdo, que neste artigo entendemos como o modo pelo qual essas plataformas tratam da gestão e do gerenciamento sobre o conteúdo publicado por terceiros em seus espaços, tanto através da remoção de postagens ou suspensão de perfis, como pela recomendação de conteúdo (Silva; Gertrudes, 2023). Apesar de não haver um consenso explícito sobre a inclusão de recomendação na mesma classificação que remoção de conteúdo, especialistas consideram que ambas podem ser consideradas ações de moderação, ainda que para finalidades distintas: a primeira como uma curadoria e a segunda como ação de intervenção (Silva; Gertrudes, 2023).

Pessoas negras tendem a ter mais postagens removidas indevidamente, principalmente quando expressam suas identidades, por exemplo, tratando de questões raciais ou denunciando situações racistas. Nesse sentido, nos Estados Unidos, verificou-se que as ferramentas de moderação de conteúdo de grandes plataformas digitais tendem a considerar a variação linguística do inglês afro-americano como altamente tóxica, em virtude de determinadas expressões utilizadas. Diferentes influenciadores digitais negros e negras também já relataram “prejuízos observados nas métricas de alcance, o fenômeno do embranquecimento de rostos em sistemas de reconhecimento [como filtros] e resultados de busca de imagens que reforçam estereótipos racistas” (Lima; Lima, 2023, p. 15). No caso de filtros de imagens que promovem o clareamento do tom de pele como uma forma de “embelezamento”, especialistas negros do país classificaram esses sistemas algorítmicos como tecnologias de risco inaceitável (Silva, 2023).

A noção de “racismo algorítmico” é uma maneira de agrupar e compreender esses diferentes fenômenos. Segundo Tarcízio Silva (2022), o racismo algorítmico pode ser definido como “o modo pelo qual a disposição de tecnologias e imaginários sociotécnicos em um mundo moldado pela supremacia branca realiza a ordenação algorítmica racializada de classificação social, recursos e violência em detrimento de grupos minorizados” (p. 68-69). Trata-se de um fenômeno que “trabalha com a categoria de racismo como estrutura e forma sistemática de discriminação”, sendo os vieses algorítmicos aqueles responsáveis por mobilizar “as categorias de preconceito racial e discriminação racial” (Kremer, 2023, p. 28).

Apesar de mais velada que a discriminação racial direta, é importante considerar que a discriminação indireta é igualmente nociva e prejudicial. Influenciadores negros e negras que utilizam as redes sociais como ferramenta de trabalho podem ser, sobremaneira, prejudicados por um alcance reduzido sem justificativa, ainda mais se optarem por abordar questões raciais em seu conteúdo (Thamara, 2023).

Como destaca Silva (2022), lidar com o racismo algorítmico significa ter de desvelar uma dupla opacidade, presente tanto em nossa relação com a tecnologia como também a raça. Primeiro, aquela que gira em torno da tecnologia, uma vez que algoritmos e sistemas de inteligência artificial (IA) são comumente tidos como objetivos e neutros. Segundo, aquela em torno do próprio racismo, que no Brasil é marcadamente por denegação (Gonzalez, 1988), ou seja, um assunto que se evita abordar diretamente. Assim, segundo Silva (2020), a opacidade dos algoritmos, que regem a visibilidade e a classificação dos conteúdos postados nas plataformas digitais sem qualquer transparência, como verdadeiras caixas pretas, é agravada pela ideologia da “cegueira racial”, típica do Brasil, que tradicionalmente dissimulou seu racismo celebrando a miscigenação e a democracia racial.

Considerando o cenário brasileiro, organizações como o coletivo Juristas Negras (2022) e o AqualtuneLab (Barbosa, 2022), ao contribuírem para a construção do marco teórico sobre IA (Sugestões…, 2022), posicionaram-se pela necessidade de uma regulação que preveja expressamente o antirracismo como um princípio basilar. Segundo o coletivo Juristas Negras (2022), é preciso considerar que “o Brasil ainda não reconheceu que suas instituições são racistas e preconceituosas, contexto no qual o estereótipo de criminoso é sempre imputado às pessoas negras, pobres e faveladas” (p. 6). Dessa forma, concluem que o vazio da norma sobre este tema “contribuirá para que mais pessoas negras sigam sendo afetadas, sem que a legislação sequer enfrente minimamente o problema” (Juristas Negras, 2022, p. 6).

Embora sejam contribuições destinadas ao contexto regulatório de sistemas de IA, esse entendimento também pode ser aplicado à regulação de plataformas digitais. Atualmente, a moderação de conteúdo online é realizada majoritariamente por meio de modelos algorítmicos, podendo ser considerada um verdadeiro produto dessas plataformas (Silva; Gertrudes, 2023). Assim, escolhas corporativas por moderar mais e/ou melhor passam também por uma avaliação acerca dos interesses financeiros das empresas, que definirá as prioridades de investimento.

Em 2020, a filósofa Djamila Ribeiro, junto com coletivos negros e uma equipe dirigida pelo jurista Adilson Moreira, chegou a ingressar com uma representação frente ao Ministério Público Federal contra o antigo Twitter, atual X, sob a alegação de que a plataforma, por meio de sua política de moderação de conteúdo, lucraria por meio da exploração econômica do racismo e da misoginia (Tardelli, 2020). Em entrevista, Moreira sustentou que a empresa teria permitido a circulação de “informações inverídicas que fomentam o ódio contra minorias” (Tardelli, 2020), mesmo tendo controle sobre as regras que se aplicam sobre o que pode circular em seu espaço.

Nesse sentido, a construção de uma regulação destinada a traçar regras e parâmetros para plataformas digitais, em especial com diretrizes mínimas para uma moderação online justa e legítima2, poderia servir como instrumento para obrigar as empresas a adotarem uma postura mais rigorosa em relação a conteúdos nocivos e ao funcionamento de seus próprios algoritmos. Considerando o caráter estrutural do racismo e sua capacidade de reprodução facilitada pela ausência de mecanismos proativos antirracistas, apresenta-se como fundamental que uma regulação para plataformas digitais preveja dispositivos específicos de enfrentamento direto. Inclusive, essa é uma recomendação de Tendayi Achiume (2020), ex-relatora especial da ONU em formas contemporâneas de racismo e intolerâncias correlatas. Em seu relatório sobre discriminação racial em tecnologias emergentes, ela ressalta que:

[...] eles [os Estados] devem abordar não apenas o racismo e a intolerância explícitos no uso e design das tecnologias digitais emergentes, mas também, e com igual seriedade, as formas indiretas e estruturais de discriminação racial que resultam do design e uso dessas tecnologias. [...] Os Estados devem rejeitar uma abordagem "cega às raças" à governança e regulamentação das tecnologias digitais emergentes, uma abordagem que ignora a marginalização específica de minorias raciais e étnicas e conceitua problemas e soluções relacionados a essas tecnologias sem levar em conta seus prováveis efeitos sobre esses grupos. (Achiume, 2020, grifo nosso, tradução nossa)

Com efeito, a tendência de uma regulação que se pretende universal é tratar os desiguais de forma igual, resultando no reforço de exclusões e marginalizações dos mesmos grupos já vulnerabilizados. Daí a necessidade de um olhar específico e atento a essas desigualdades, visando endereçá-las de forma adequada. Analisaremos, na sequência deste artigo, como esse tema foi abordado e enfrentado na consulta sobre regulação de plataformas digitais realizada pelo CGI.br.

Análise da consulta do CGI.br: considerações metodológicas

Entre 25 de abril e 16 de julho de 2023, o CGI.br abriu uma consulta pública sobre regulação de plataformas digitais, visando ir além da discussão regulatória até então pautada pelo Projeto 2.630 (Brasil, 2020) no país, popularmente conhecido como “PL das Fake News” (Soares, 2023). A consulta explorou definições e classificações de plataformas, apresentando um mapeamento dos riscos envolvidos em suas atividades, assim como medidas regulatórias capazes de mitigá-los. Uma série de perguntas foram estruturadas em três eixos principais, que versavam sobre “quem regular?”, “o que regular?” e “como regular?”. Foram obtidas mais de 1,3 mil contribuições, cujo resultado foi sistematizado e divulgado pelo próprio CGI.br (Regulação…, 2023).

Considerando o impacto desse documento, que representa uma síntese das principais contribuições de diversos setores da sociedade sobre o tema, pretendemos explorar esse material e analisar em que medida a questão racial despontou como central ou não, tanto no texto da chamada do Comitê, quanto nas respostas dos participantes. Antes de apresentarmos os resultados obtidos, explicaremos a metodologia utilizada. Nosso estudo partiu de uma análise de conteúdo com base nas contribuições sistematizadas e disponibilizadas em formato .CSV3 pelo Comitê em dois momentos: primeiro, com foco no endereçamento da temática pelo consulente; na sequência, nos comentários dos consultados.

O primeiro momento procurou compreender se a discussão sobre raça foi incentivada na consulta e, em caso positivo, como foi, analisando-se, portanto, o endereçamento pelo consulente. Para seleção das colunas a serem analisadas, nosso estudo apoiou-se no dicionário disponibilizado pelo Comitê4, nas colunas “capítulo” e “pergunta”. Uma vez que houve contribuições nos três capítulos e/ou eixos temáticos e nas 43 perguntas propostas, optamos por analisar os termos utilizados nas duas colunas. Para o segundo momento, cujo objetivo era compreendermos se a raça foi uma categoria indicada nas contribuições e como ela foi mobilizada, limitamo-nos a fazer a busca na coluna “comentario_texto”, descrito como o único campo no qual foi sistematizado o “conteúdo do comentário”.

Tendo em vista o foco deste trabalho, buscamos pelos seguintes termos no documento citado: “racismo”, “raça”, “negro”, “negra”, “preto”, “preta”, “etnia” e “discriminação racial”5. Os resultados considerados em ambos os momentos da análise foram aqueles indexados com a expressão “termo encontrado” no arquivo do documento. Na sequência, foram excluídos apenas resultados que não correspondiam ao tema investigado; em alguns casos, por exemplo, o termo “preta” foi localizado por estar contido na palavra “interpretação”.

A análise das menções finais foi feita a partir das seguintes perguntas orientadoras: Qual o tema do eixo? Quantas menções foram encontradas e de quais termos? Em quais momentos e para qual finalidade foi feita a menção? O que o número de menções significa? Qual sua posição no texto? Em que medida as menções contribuem para uma regulação de plataformas?

A raça na pergunta do consulente

Por meio da busca dos termos “racismo”, “raça”, “negro”, “negra”, “preto”, “preta”, “etnia” e “discriminação racial” nas colunas “capítulo” e “pergunta”, identificamos que nenhum dos termos foram encontrados em quaisquer dos eixos da consulta. Na leitura geral dos capítulos e das perguntas propostas, observamos que os direcionamentos dados pelo CGI.br buscaram i) contextualizar o tema/eixo em questão e ii) apresentar as perguntas com exemplos, quando cabível. Assim, apesar de ter aparentemente buscado uma descrição mais genérica, houve uma preocupação em explicar de forma adequada o que era solicitado, exemplificando possíveis tópicos que poderiam ser abordados nas respostas dos contribuintes.

Inferimos, em princípio, que a questão racial está abarcada pelo tema tratado por alguns eixos, como o de riscos à Democracia e aos Direitos Humanos. Na seção “o que regular?”, mencionamos o interesse do consulente em explorar possíveis impactos sobre direitos fundamentais, como o da não discriminação, além dos riscos associados ao discurso de ódio. No entanto, não há um endereçamento específico da questão racial, uma vez que a concepção de Direitos Humanos e não discriminação é ampla, podendo abarcar diversos temas. Em verdade, verificamos que a abordagem mais genérica, sem identificar um grupo em particular, parece ter orientado os textos de todas as perguntas, com exceção daquelas dirigidas especificamente à proteção das “crianças e adolescentes”.

Essa abordagem não afasta, entretanto, a preocupação com relação a uma abordagem regulatória que explicite e proteja as populações racializadas no Brasil, ainda mais pela preocupação expressa com riscos discriminatórios. Em um país estruturalmente racista, abordar a raça como um elemento central, quiçá entre os exemplos mencionados na chamada, poderia contribuir para uma regulação mais apropriada e eficiente, especialmente tendo em vista a contenção de violações aos direitos fundamentais em ambientes online contra grupos racializados.

A raça nos comentários dos consultados

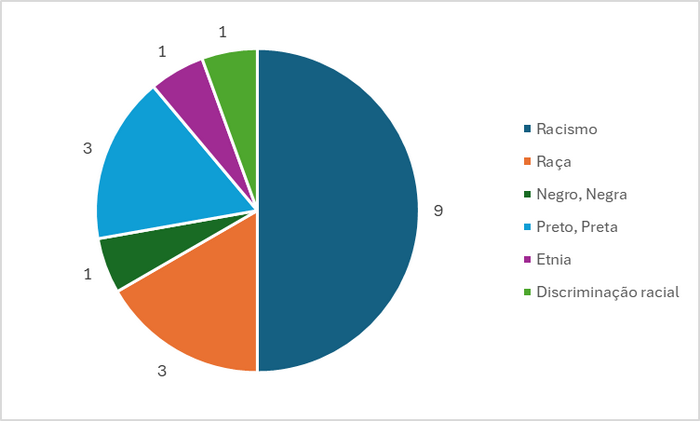

Ao se buscar pelos termos “racismo”, “raça”, “negro”, “negra”, “preto”, “preta”, “etnia” e “discriminação racial” na coluna “comentario_texto” do documento com a sistematização de todas as contribuições, eles foram encontrados, em conjunto ou separadamente, em 22 comentários/contribuições, conforme quadro a seguir:

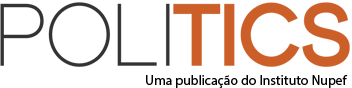

Gráfico 1 – Resultado da busca nas contribuições dos consultados por termos

Fonte: Elaboração própria.

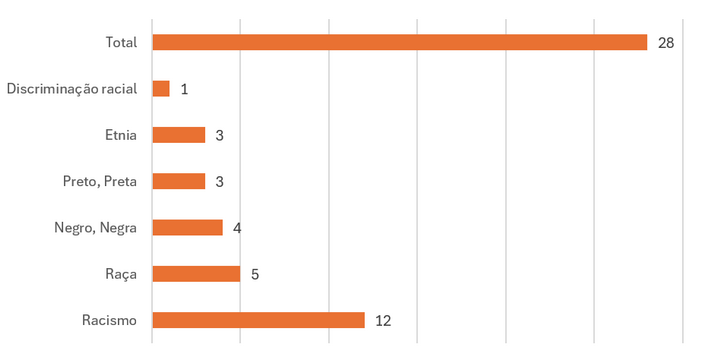

Observamos, segundo os critérios de região e setor do autor das contribuições, maior frequência das menções nas respostas da região Sudeste e do terceiro setor. Notamos que não houve referência aos termos nas contribuições de autores da Região Sul, que respondiam por apenas 4% do total de respostas, nem nas participações do setor empresarial ou governamental, que, juntos, somaram 19,5% do total de contribuições.

Gráfico 2 – Contribuições com menção aos termos por região e setor da autoria

Fonte: Elaboração própria.

Visando organizar melhor o estudo desse material, o resultado dos termos encontrados serão analisados conforme os tópicos da consulta pública em que apareceram, quais sejam: “Quem regular”, “O que regular” e, por fim, “Como regular”.

5.1 Quem regular?

No tópico “Quem regular?”, o objetivo da consulta foi abordar a abrangência conceitual e o escopo sobre o qual recai a regulação, ou seja, a intenção foi compreender o que se entende por “plataformas digitais”. O capítulo 1 foi o que teve o menor número de perguntas em relação aos outros (quatro ao todo), as quais buscavam por “definições, tipologias e áreas de atuação das plataformas digitais” (NIC.br, 2023, p. 11).

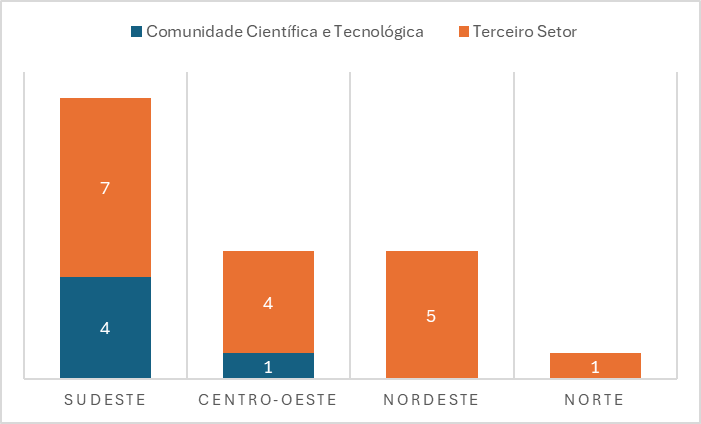

A seção teve 225 contribuições. Os termos pesquisados em nossa análise foram identificados, entretanto, em apenas quatro delas, sempre em perguntas distintas do mesmo capítulo. Foi encontrada uma menção para os termos “racismo”, “raça”, “negro/negra”, “preto/preta” e “etnia”. Não foram identificadas menções ao termo “discriminação racial”.

Gráfico 3 – Resultado da busca nas contribuições dos consultados para o Eixo 1

Fonte: Elaboração própria.

Uma das contribuições, em resposta à melhor definição de “plataformas digitais”, indicou a importância de estimular “a diversidade e a equidade de classe, raça, gênero, orientação sexual e outros”6. Outro consultado salientou que a segmentação da sociedade em nichos a partir de padrões, como a etnia, deveria ser considerada fortemente, destacando ser natural às plataformas segmentarem os dados em diversas classes, embora elas criem uma ideia superficial de pluralidade, podendo contribuir para a manutenção de determinados grupos em situação de inferioridade social7.

A menção ao racismo ocorreu em comentário que tratou do “controle essencial de acesso (gatekeeper)”. O termo foi mencionado em um apelo para que a atuação do gatekeeper fosse avaliada à “luz da universalidade de acesso aos cuidados digitais”8. Isso é, para além da proteção contra a concentração de mercado, o comentário sugere que, na análise da atuação da plataforma em serviços essenciais, seja considerado como o agente protege corpos e existências de violências, como o racismo.

Por fim, embora tenhamos identificado uma menção nesse capítulo aos termos “pretas” e “negras”, a análise apurou que eles não foram utilizados com sentido racial. O termo “pretas” foi empregado como adjetivo de “caixas pretas”, em referência à comunicação não transparente de empresas que mascaram seu real modelo de negócio9, ao passo que o termo “negras” se tratou de uma referência a outro comentário da consulta, das “Blogueiras Negras”10.

No geral, os termos aparecem em trechos que evidenciam a importância de considerar os impactos das plataformas sobre determinados grupos, apontando para a importância de uma regulação protetiva, sendo a raça ou a etnia indicada como um desses marcadores.

5.2 O que regular?

No tópico “O que regular?”, o objetivo da consulta era colher contribuições acerca dos riscos provenientes da atividade de plataformas digitais, assim como possíveis medidas de mitigação. Sendo o eixo que mais recebeu contribuições, contava com 34 perguntas referentes a quatro grandes conjuntos de riscos que versavam sobre: i) concorrência, direito do consumidor, abuso de poder econômico e concentração econômica e de dados; ii) soberania digital, desenvolvimento tecnológico e inovação; iii) trabalho decente; e iv) Democracia e Direitos Humanos (NIC.br, 2023, p. 63).

No total, foram encontradas nove menções ao termo “racismo”, três menções dos termos “raça” e “negro/negra” e uma menção aos termos “preto/preta” e “discriminação racial”. A maioria das menções concentra-se no eixo de riscos à Democracia e aos Direitos Humanos, indicando, como esperado, uma associação maior da questão racial a esses temas.

Gráfico 4 – Resultado da busca nas contribuições dos consultados para o Eixo 2

Fonte: Elaboração própria.

Nesse eixo, os termos apareceram para apontar que o racismo é um problema grave em plataformas digitais, causado tanto pela proliferação de discurso de ódio racista como pelos próprios algoritmos utilizados para moderação de conteúdo que, em alguns casos, reduzem o alcance ou suspendem injustamente a conta de pessoas que se posicionam contra o racismo11. As menções também aparecem relacionadas a medidas de mitigação, como a adoção de uma moderação de conteúdo humana mais plural e representativa, a fim de identificar melhor o discurso de ódio contra pessoas negras12. Além disso, propõem-se a obrigatoriedade de auditorias algorítmicas externas e avaliação de padrões de códigos discriminatórios13, de apresentação periódica de relatórios de transparência e accountability, com medidas para enfrentar a discriminação racial, inclusive a indireta, bem como o investimento público para a formação de grupos interdisciplinares e multissetoriais dedicados a desenvolver, analisar e auditar modelos algorítmicos nos termos do Estatuto da Igualdade Racial14.

Dentre as ameaças à Democracia e aos Direitos Humanos, identificamos menções que tratavam especificamente dos riscos associados a jogos online, com a questão central nas distorções de imagem proporcionadas por eles: crianças e adolescentes negros possivelmente evitam utilizar avatares que representassem adequadamente a cor de sua pele para não sofrerem racismo15. Outro problema associado à juventude negra foi encontrado no eixo de riscos ao trabalho decente: uma contribuição apontou que, no caso de aplicativos de entrega de comida, em que o ganho do entregador aumenta com a quantidade e a velocidade de cada entrega, é possível traçar um perfil específico dos adolescentes mais vitimados por esse tipo de trabalho infantil: são meninos de 14 a 17 anos, pretos e de origem familiar vulnerabilizada socioeconomicamente16. Nesse mesmo eixo, outra menção apontava para a necessidade de respeito às leis trabalhistas locais e à representatividade da população brasileira em gênero, raça e afins para a contratação de trabalhadores por essas plataformas.

Nos eixos dos riscos relacionados a concorrência, consumo, economia, soberania digital e desenvolvimento tecnológico, por sua vez, as menções concentraram-se novamente em propor medidas de mitigação de vieses algorítmicos e, ainda, aplicação de multas e outras sanções. No que tange a essa última, a contribuição foi no sentido da previsão de penalidades quando a qualidade dos serviços oferecidos for comprometida devido à falta de observância a normas locais, como aquelas de combate ao racismo17. De outra sorte, como medidas de mitigação, foram relacionadas novamente as auditorias algorítmicas, agora ao lado de requisitos de transparência, diversidade, inclusão, salvaguardas contra discriminação18 e análise de riscos sistêmicos por meio do dever de cuidado19.

Por fim, houve uma menção ao termo “preto” no eixo sobre concorrência, consumo e economia, mas apenas no título de uma das referências utilizadas: um texto de Paulo Victor Melo que defende a diversidade não somente nas telas, como também por trás delas. A contribuição em si dizia respeito ao impacto negativo da concentração de mercado e do abuso de poder no ecossistema midiático brasileiro20.

De todas essas menções, percebemos que houve uma importante preocupação com os riscos advindos da perpetuação do racismo através e pelas plataformas digitais. As sugestões de medidas de mitigação foram variadas e apontam caminhos importantes. Em especial, chama à atenção a sugestão de relatórios de transparência que tratem especificamente das medidas contra a discriminação racial e de times de moderação humana e equipes de desenvolvimento de IA mais diversas, com a participação de pessoas negras. Trata-se de elementos que reconhecem explicitamente a questão racial e a colocam como eixo central para a atuação das plataformas, contribuindo para o desvelamento do problema.

5.3 Como regular?

No capítulo de perguntas “Como regular: arranjos institucionais”, o objetivo foi colher análises e sugestões sobre os arranjos necessários para implementar a regulação das plataformas, considerando a complexidade e a transversalidade de suas atividades. A partir de cinco perguntas, foram exploradas a arquitetura regulatória, a indicação de atores e a definição de seus papéis e responsabilidades (NIC.br, 2023, p. 23).

Essa seção teve o menor número de contribuições: 135 no total. Dentre elas, os termos pesquisados foram identificados em apenas duas contribuições. Foram encontradas duas menções ao termo “racismo” e uma a “raça” e “etnia”, e não foram identificadas menções aos termos “negro/negra”, “preto/preta” e “discriminação racial”.

Gráfico 5 – Resultado da busca nas contribuições dos consultados para o Eixo 3

Fonte: Elaboração própria.

A primeira menção ao termo “racismo” foi feita com o intuito de citar a participação de Organizações não Governamentais (ONG) e Institutos de Pesquisa no combate ao racismo, indicados como outros atores que devem ser envolvidos na regulação da plataforma21. Incida-se “outros atores” porque a pergunta que dirige a resposta foi feita para mapear outros atores para além daqueles envolvidos diretamente com a implementação. Convém destacar que não identificamos, no levantamento ou na leitura direta das consultas, menção expressa da importância de representações institucionais comprometidas com a equidade racial estarem diretamente envolvidas na regulação. Os atores, na única citação encontrada, exerceriam um papel apenas secundário.

A segunda menção ao “racismo” e a menção aos termos “raça” e “etnia” ocorreram em um mesmo comentário22, que respondia à pergunta sobre a necessidade de criação de novas instituições para a implementação da regulação de plataformas digitais. Propondo a criação de um novo conselho representativo e multissetorial, com foco nas pessoas, a sugestão cita os problemas estruturais relacionados a classe, misoginia e racismo no Brasil, argumentando que eles demandariam uma atuação especial do órgão. É defendida, portanto, uma autoridade composta com “diversidade regional, de gênero, de etnia, de raça, de deficiência”, afirmando que não há hoje no país órgão com tal desenho e configuração. A proposição é pertinente por estabelecer que a raça seja explicitamente considerada no desenho da autoridade proposta; desse modo, norteia um compromisso de combate ao racismo também na observância de representações comprometidas com a igualdade racial.

Conclusão

Embora a análise da consulta sobre regulação de plataformas digitais realizada pelo CGI.br aponte para um avanço do debate no Brasil em relação à questão racial, ainda é possível identificar alguns limites e dificuldades. Dada a dimensão do racismo no Brasil, em suas múltiplas manifestações, diretas ou indiretas, envolvendo diversas formas de violência e graves violações de direitos fundamentais em grande escala nos ambientes online, qualquer esforço regulatório que trate da moderação de conteúdo em grandes plataformas digitais tem a obrigação de tratar esse tema de maneira direta e explícita, devendo ser incisivo no enfrentamento e na adoção de medidas antirracistas de mitigação.

A postura do consulente na formulação das questões tendeu a ser mais genérica, sem indicar diretamente a questão racial. Tal abordagem contribui com o ocultamento do problema: a omissão ou a não ação impede o enfrentamento das discriminações raciais sofridas por e no ambiente digital adequadamente. Entendemos, assim, que as contribuições poderiam avançar mais nessa temática se a raça fosse endereçada na consulta de forma mais explícita e central.

Na análise das contribuições, destaca-se especialmente o eixo de riscos à democracia e aos Direitos Humanos no âmbito do tópico “O que regular?”, no qual identificamos 18 menções aos termos pesquisados, demonstrando uma preocupação significativa com a questão racial. As propostas ressaltam a importância de uma moderação de conteúdo mais plural e justa, guiada por valores como a transparência, a igualdade e a diversidade. Merece destaque a sugestão de medidas de mitigação, por exemplo a apresentação de relatórios de transparência que explicitem ações adotadas contra a discriminação racial. Alguns comentários, na linha defendida neste artigo, destacam a importância de uma postura ativa contra o racismo, envolvendo a análise de riscos sistêmicos, especialmente em um país estruturalmente racista como o nosso, e a necessidade de ações preventivas e do dever de cuidado.

Por fim, no tópico “Como regular?”, merece destaque a sugestão de criação de uma nova autoridade regulatória no Brasil, com composição diversa, levando em consideração a representação racial, um ponto relevante e frequentemente negligenciado em nosso país. A importância desse debate é ainda maior em razão da centralidade e da polêmica envolvida na discussão legislativa acerca de quem deveria assumir a responsabilidade regulatória nesse domínio. Uma autoridade regulatória pouco representativa em termos raciais é um mal começo, aumentando a tendência reprodutiva de nosso racismo estrutural.

Concluímos este estudo ressaltando a importância da iniciativa do CGI.br, que tem fomentado o debate qualificado sobre a regulação de plataformas digitais no Brasil e permitido que, entre outros temas, também a questão racial seja endereçada e enfrentada. Esperamos que novas consultas e debates sejam promovidos, abordando também o racismo algorítmico em suas diversas dimensões, nas e por meio das plataformas digitais, assim como a necessidade da adoção de medidas antirracistas.

Referências

ACHIUME, Tendayi. Racial discrimination and emerging digital technologies: a human rights analysis. Geneva: UN, Human Rights Council, 2020. Disponível em: https://digitallibrary.un.org/record/3879751/files/A_HRC_44_57-EN.pdf?l…. Acesso em: 28 nov. 2024.

ALVES, M.A.S.; MACIEL, E.H. O fenômeno das fake news: definição, combate e contexto. Internet & Sociedade, v. 1, n. 1, p. 144-171, 2020.

BARBOSA, Arthur Almeida Menesês et al. Documento Preto: contribuições do AqualtuneLab para o debate sobre regulação de Inteligência Artificial no Brasil. 2022. Disponível em: https://aqualtunelab.com.br/wp-content/uploads/2022/11/AQUALTUNELAB-Doc…. Acesso em: 24 nov. 2024.

BRASIL. Decreto n. 10.932, de 10 de janeiro de 2022. Promulga a Convenção Interamericana contra o Racismo, a Discriminação Racial e Formas Correlatas de Intolerância, firmado pela República Federativa do Brasil, na Guatemala, em 5 de junho de 2013. Brasília, DF: Presidência da República, [2022]. Disponível em: https://www.planalto.gov.br/ccivil_03/_Ato2019-2022/2022/Decreto/D10932…. Acesso em: 19 fev. 2024.

BRASIL. Projeto de Lei 2630/2020. Institui a Lei Brasileira de Liberdade, Responsabilidade e Transparência na Internet. Brasília: Câmara dos Deputados, 2020. Disponível em: https://www.camara.leg.br/proposicoesWeb/prop_mostrarintegra?codteor=19…. Acesso em: 30 nov. 2024.

COMITÊ GESTOR DA INTERNET. Consulta sobre Regulação de Plataformas Digitais. 2023. Disponível em: https://dialogos.cgi.br/documentos/debate/consulta-plataformas/. Acesso em: 28 nov. 2024.

GONZALEZ, Lélia. A categoria político-cultural de amefricanidade. Tempo Brasileiro, Rio de Janeiro, n. 92/93, jan./jun. 1988, p. 69-82.

JURISTAS NEGRAS. Contribuição JURISTAS NEGRAS. 10 jun. 2022. Disponível em: https://legis.senado.leg.br/sdleg-getter/documento/download/2bf6209f-f6…. Acesso em: 25 jun. 2023.

KREMER, Bianca. Racismo algorítmico. Rio de Janeiro: CESeC, 2023.

LIMA, Brunno Ewerton de Magalhães; LIMA, Carla Fernanda de. Racismo algorítmico: vivências e percepções de influenciadores(as) digitais negros(as). Revista África e Africanidades, ano 16, ed. 47-48, ago./nov. 2023. Disponível em: https://africaeafricanidades.com.br/documentos/ARTLIV03_ed.47-48.pdf. Acesso em: 20 nov. 2024.

MOURA, Clóvis. Sociologia do negro brasileiro. São Paulo: Perspectiva, 2019.

NASCIMENTO, Abdias do. O genocídio do negro brasileiro: processo de um racismo mascarado. São Paulo: Perspectiva, 2016.

NÚCLEO DE INFORMAÇÃO E COORDENAÇÃO DO PONTO BR (ed.). Sistematização das contribuições à consulta sobre regulação de plataformas digitais. São Paulo: Núcleo de Informação e Coordenação do Ponto BR, 2023.

REGULAÇÃO de plataformas digitais: relatório do CGI.br mapeia consensos e dissensos entre setores. CGI.br. 13 dez. 2023. Disponível em: https://cgi.br/noticia/releases/regulacao-de-plataformas-digitais-relat…. Acesso em: 26 nov. 2024.

SILVA, Fernanda dos Santos Rodrigues; GERTRUDES, Júlia Maria Caldeira. Governança da moderação de conteúdo online: percepções sobre o papel dos atores e regimes. Belo Horizonte: Instituto de Referência em Internet e Sociedade, 2023. Disponível em: https://bit.ly/3WHMUIg. Acesso em: 20 jan. 2024.

SILVA, Fernanda dos Santos Rodrigues. “Nada mais sobre nós sem nós”. Escurecendo o Debate sobre a Regulação de IA no Brasil e Pensando Mecanismos de Combate ao Racismo Algorítmico. Relatório de Pesquisa do Programa Líderes LACNIC, 2023. Disponível em: https://www.lacnic.net/innovaportal/file/6974/1/regulacao-de-ia-e-discr…. Acesso em: 24 nov. 2024.

SILVA, Tarcízio. Racismo algorítmico: inteligência artificial e discriminação nas redes digitais. São Paulo: Edições Sesc São Paulo, 2022.

SILVA, Tarcízio. Racismo Algorítmico em Plataformas Digitais: microagressões e discriminação em código. In: SILVA, Tarcízio (org.). Comunidades, algoritmos e ativismos digitais: olhares afrodiaspóricos. São Paulo: Literarua, 2020, p. 121-137.

SOARES, Matheus. CGI abre consulta pública sobre regulação de plataformas digitais no Brasil. desinformante*, 25 abr. 2023. Disponível em: https://desinformante.com.br/cgi-consulta-publica/. Acesso em: 26 nov. 2024.

SUGESTÕES ao marco regulatório da IA serão recebidas até 13 de maio. Agência Senado, 4 abr. 2022. Disponível em: https://www12.senado.leg.br/noticias/materias/2022/04/04/sugestoes-ao-m…. Acesso em: 24 nov. 2024.

TARDELLI, Breno. Adilson Moreira: ‘Twitter explora economicamente racismo e misoginia?’. Carta Capital, 25 ago. 2020. Disponível em: https://www.cartacapital.com.br/justica/adilson-moreira-twitter-explora…. Acesso em: 24 nov. 2024.

THAMARA, Ariel. Como os vieses raciais no Instagram impactam na vida de criadores de conteúdo negros? In: CUSTÓDIO, Leonardo et al (orgs.). Práticas de comunicação antirracista no Brasil. 1 ed. Rio de Janeiro: Criola, 2023.

UNESCO. Diretrizes para a governança das plataformas digitais: salvaguardar a liberdade de expressão e o acesso à informação com uma abordagem multissetorial. Disponível em: https://unesdoc.unesco.org/ark:/48223/pf0000387560, pp. 21 - 22.

UNITED NATIONS (UN). Pact for the future, Global Digital Compact, and Declaration on Future Generations. Summit of the Future, Outcome Documents, september 2024. Disponível em: https://www.un.org/sites/un2.un.org/files/sotf-pact_for_the_future_adop…. Acesso em: 30 nov. 2024.

==

1 Escolhemos neste estudo, como recorte metodológico, abordar a questão do racismo sobre as pessoas negras em função do histórico escravocrata no país, bem como do contexto de vulnerabilidade dessa população no espaço digital, a ser melhor explicitado na próxima seção. A escolha, no entanto, não reflete desconhecimento ou ignorância da questão racial contra pessoas indígenas online, que pode ser objeto de trabalhos futuros.

2 Novamente, destaca-se que a intenção não é realizar uma confusão entre regulação de plataformas digitais e regulação de moderação de conteúdo, pelo contrário: ao reconhecer o impacto desta atividade sobre a existência e identidade de pessoas negras no ambiente digital, o foco se dá sobre ela por sua relevância para a pesquisa.

3 A tabela completa utilizada para a pesquisa pode ser consultada em: https://dialogos.cgi.br/documentos/debate/consulta-plataformas/. Acesso em 11 maio 2025.

4 Disponível em: https://dialogos.cgi.br/documentos/debate/consulta-plataformas/. Acesso em 11 maio 2025.

5 A expressão “preconceito racial” não foi utilizada para busca, uma vez que, diferentemente da discriminação racial, considera-se apenas “o juízo baseado em estereótipos acerca de indivíduos que pertençam a um determinado grupo racializado, e que pode ou não resultar em práticas discriminatórias. [...] é a atribuição de tratamento diferenciado a membros de grupos racialmente identificados” (Almeida, 2018).

6 Comentario_id 1252.

7 Comentario_id 892.

8 Comentario_id 1170.

9 Comentario_id 1168.

10 Comentario_id 1168.

11 Comentario_id 151, 247, 1134, 1271 e 541.

12 Comentario_id 1128.

13 Comentario_id 162 e 249.

14 Comentario_id 1059.

15 Comentario_id 795.

16 Comentario_id 769.

17 Comentario_id 749.

18 Comentario_id 359.

19 Comentario_id 1065.

20 Comentario_id 561.

21 Comentario_id 850.

22 Comentario_id 1183.